Информация является одним из основных понятий в современном мире. Она является ключевым ресурсом и основой для развития общества и науки. В наши дни огромный объем информации создается и передается ежесекундно. Однако, как определить объем информации и как измерить ее количество? В этой статье мы рассмотрим вероятностный подход к измерению объема информации.

Вероятностный подход базируется на теории вероятностей и статистике. Он основан на идее, что количество информации, которое содержится в сообщении, зависит от вероятности появления его составляющих элементов. Другими словами, чем более вероятно появление определенного элемента, тем меньше информации содержится в его включении.

Для измерения объема информации с использованием вероятностного подхода используется понятие "энтропия". Энтропия является мерой неопределенности или неуверенности и определяет количество информации, необходимое для передачи сообщения или для описания некоего состояния системы. Чем меньше энтропия, тем меньше информации содержится в сообщении или состоянии системы. И наоборот, чем больше энтропия, тем больше информации нужно для передачи сообщения или описания состояния системы.

Вероятностный подход к измерению объема информации является одним из наиболее точных и универсальных способов. Он позволяет проводить качественный и количественный анализ информации, оценивать ее степень неопределенности и повышать ее эффективность. Важно отметить, что в современном информационном обществе измерение объема информации необходимо для различных областей, таких как информационные технологии, телекоммуникации, физика, биология и другие.

Измерение объема информации

Вероятностный подход к измерению объема информации основан на предположении, что вероятность появления определенного события связана с количеством неожиданности, или "удивительности", этого события. Соответственно, информационная стоимость события определяется как обратная величина его вероятности.

Таким образом, измерение объема информации с использованием вероятностного подхода позволяет определить степень "неожиданности" или "удивительности" определенной информации. Использование этого подхода позволяет более точно оценить стоимость передаваемой информации и позволяет оптимизировать процессы хранения, передачи и обработки данных.

Применение вероятностного подхода к измерению объема информации позволяет оценить эффективность информационных систем, а также разрабатывать новые алгоритмы и методы обработки данных. Этот подход является одной из основных основ теоретической информатики и позволяет улучшить качество и эффективность информационных технологий в целом.

Вероятностный подход: основные принципы и применение

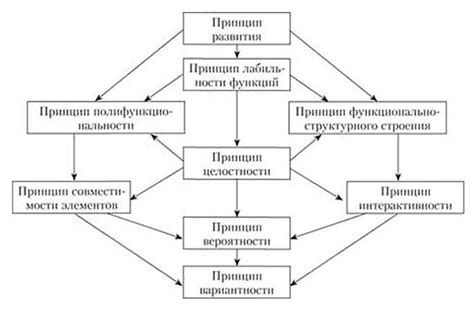

Основные принципы вероятностного подхода включают:

- Математическое моделирование - создание математических моделей для описания случайных процессов и явлений. Математические модели позволяют провести анализ и предсказание вероятностей различных исходов, что является основой для измерения объема информации.

- Вероятностные расчеты - используются для определения вероятности возникновения различных событий и их взаимосвязей. Вероятностные расчеты основаны на теории вероятностей и позволяют количественно измерять объем информации.

- Статистический анализ - проведение статистического анализа данных для получения информации о вероятности различных исходов. Статистический анализ позволяет определить закономерности и распределение вероятностей, что является ключевым элементом в измерении объема информации.

Вероятностный подход находит применение в различных областях, включая:

- Теория информации - позволяет измерять информацию, содержащуюся в сообщениях, и оценивать эффективность передачи информации.

- Статистика - используется для анализа данных, полученных в рамках статистических исследований. Вероятностный подход позволяет проводить статистический анализ и определять параметры распределений данных.

- Машинное обучение - вероятностные методы используются для обработки и анализа больших объемов данных и для построения моделей машинного обучения.

Вероятностный подход является мощным инструментом для измерения объема информации и находит широкое применение в различных областях. Он позволяет количественно оценить вероятность различных исходов и провести анализ информации, содержащейся в данных.

Цифровые технологии и объем информации

Современный мир невозможно представить без цифровых технологий. Они проникают во все сферы нашей жизни, от коммуникаций и развлечений до работы и управления. В связи с этим объем информации, которую мы создаем и потребляем, постоянно растет.

Цифровые технологии позволяют нам собирать, обрабатывать и хранить огромные объемы данных. Например, социальные медиа, онлайн-сервисы и электронная коммерция генерируют огромное количество информации каждый день.

Однако, необходимо уметь эффективно управлять этой информацией. Измерение объема информации является важной задачей в этом процессе. Вероятностный подход к измерению объема информации позволяет оценить количество информации, содержащейся в некоторых данных.

Этот подход основан на теории информации и использует понятие энтропии. Энтропия позволяет оценивать степень неопределенности или разнообразия данных. Чем больше разнообразие, тем больше информации содержится в этих данных.

Оценка объема информации с использованием вероятностного подхода позволяет нам понять, насколько информативными являются данные. Это может быть полезно, например, для определения значимости определенных событий в большом объеме данных, или для сравнения разных наборов данных.

Таким образом, цифровые технологии и объем информации тесно связаны. Измерение объема информации с использованием вероятностного подхода позволяет нам более эффективно управлять этой информацией и извлекать из нее ценную информацию.

Математическая модель измерения объема информации

Математическая модель измерения объема информации основывается на вероятностном подходе. В рамках этой модели, информация рассматривается как некоторое событие или сообщение, которое можно описать с помощью вероятности его возникновения.

Сформулируем базовые определения модели:

Событие (или сообщение) - это элементарное событие или последовательность элементарных событий, каждое из которых имеет свою вероятность.

Вероятность события - это числовое значение, отражающее степень возможности его возникновения. Вероятность определяется в интервале от 0 до 1, где 0 означает невозможность события, а 1 - его абсолютную уверенность.

Информационное содержание события - это количественная характеристика события, которая позволяет оценить, насколько это событие необычно или неожиданно. Чем меньше вероятность события, тем больше его информационное содержание.

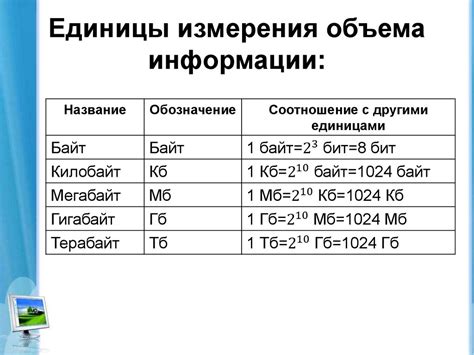

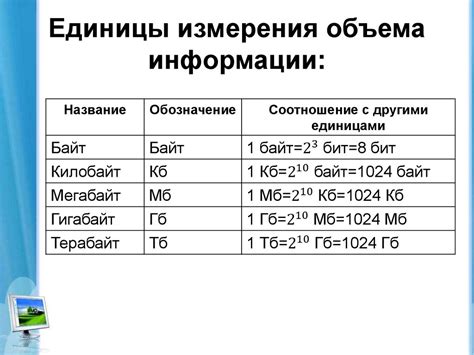

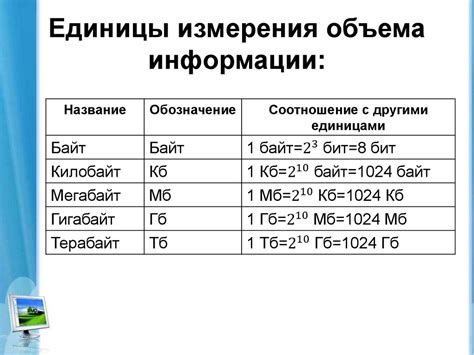

Для измерения объема информации используется бит - минимальная единица информации. Бит отражает одну бинарную альтернативу - наличие или отсутствие события.

Математически модель измерения объема информации выглядит следующим образом:

I = -log2(P)

Где:

- I - информационное содержание события (в битах)

- P - вероятность события

- log2(P) - двоичный логарифм вероятности события

Таким образом, чем меньше вероятность события, тем больше его информационное содержание (и, следовательно, требуется больше бит для его передачи).

Алгоритмы измерения объема информации

Один из таких алгоритмов – алгоритм Шеннона. Он основан на концепции энтропии, которая рассматривает вероятности различных символов или событий. Алгоритм Шеннона позволяет оценить, насколько информативным является набор данных, опираясь на вероятности его составляющих элементов.

Другим известным алгоритмом является алгоритм Фано. Он базируется на идее разделения информационного потока на более простые и понятные его составляющие. Алгоритм Фано применяется для разбиения данных на более короткие блоки, что позволяет оптимизировать их хранение и передачу.

Также стоит упомянуть алгоритм Хаффмана, который широко используется для сжатия информации. Он основывается на принципе замены более часто встречающихся символов исходного набора данных короткими кодами, а менее часто встречающихся символов - более длинными кодами. Такая замена позволяет сократить количество бит, необходимых для представления информации без потери ее содержания.

Практические примеры измерения объема информации

Пример 1: Измерение объема информации в текстовом файле

Допустим, у нас есть текстовый файл, содержащий информацию о продажах компании за последний год. Чтобы измерить объем информации в этом файле, мы можем использовать понятие энтропии.

Энтропия - это мера неопределенности или "порядочности" информации. В текстовом файле каждый символ имеет определенную вероятность появления. Например, символ "а" может появиться чаще, чем символ "я". Чем больше неопределенность, тем больше энтропия.

Используя энтропию, мы можем измерить объем информации в текстовом файле. Чем выше энтропия, тем больше информации содержится в файле.

Пример 2: Измерение объема информации в изображениях

Другой практический пример измерения объема информации связан с изображениями. Изображения состоят из пикселей, каждый из которых имеет определенную интенсивность цвета.

Чтобы измерить объем информации в изображении, мы можем использовать понятие битовой глубины. Битовая глубина определяет количество бит, используемых для представления интенсивности цвета пикселя. Чем больше битовая глубина, тем больше информации может быть передано для каждого пикселя.

Таким образом, мы можем измерить объем информации в изображении, умножив количество пикселей на битовую глубину. Чем выше полученное значение, тем больше информации содержится в изображении.